Nvidia zeigt AI-Technologie, die VRAM-Verbrauch von Spielen um bis zu 85 % senken soll

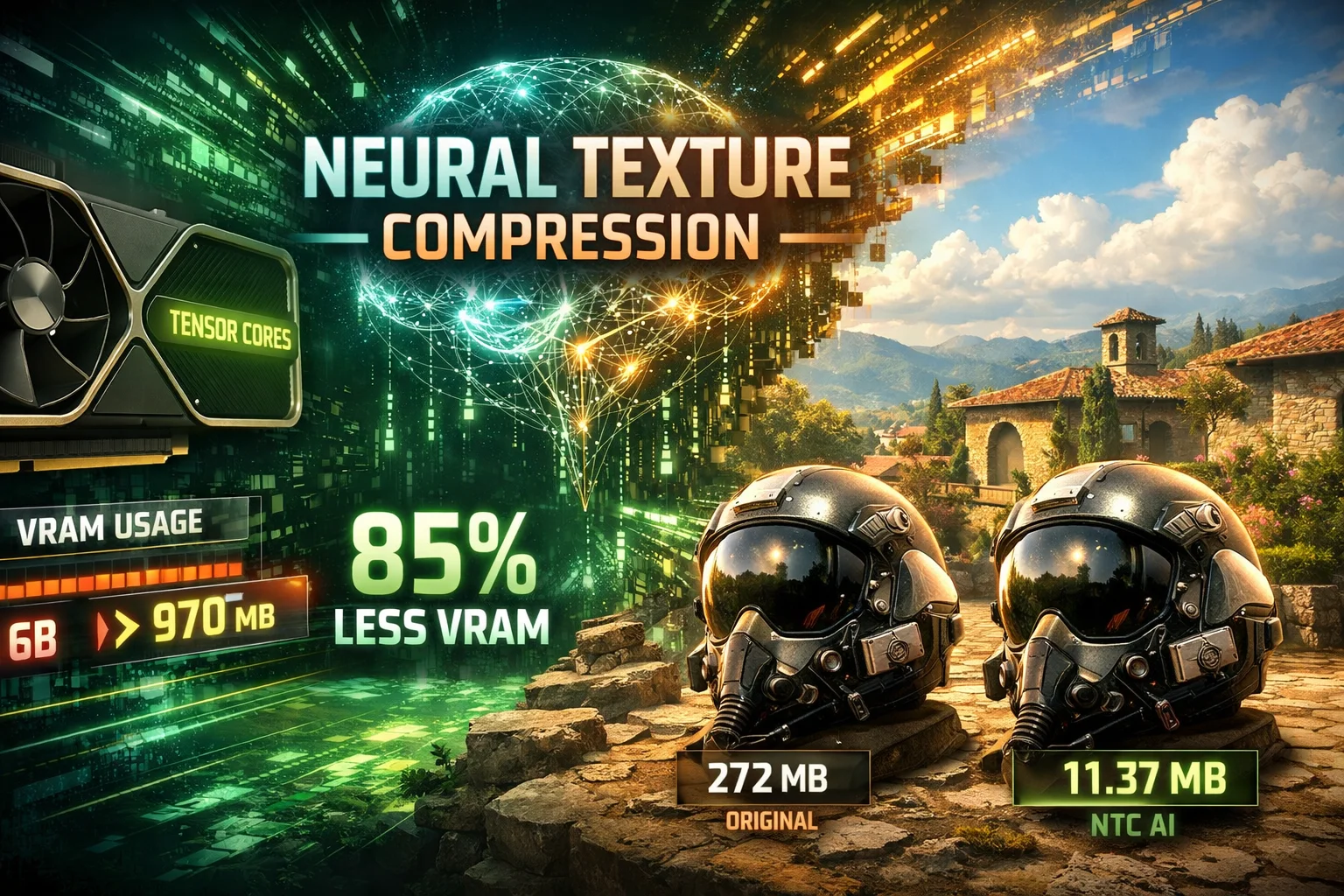

Moderne Spiele werden immer realistischer – aber auch immer speicherhungriger. Besonders der VRAM-Verbrauch aktueller Titel sorgt regelmäßig für Diskussionen unter PC-Spielern. Nvidia hat nun eine Technologie vorgestellt, die genau dieses Problem lösen könnte: Neural Texture Compression (NTC). Laut einer Demo soll sie den benötigten Grafikspeicher um bis zu 85 % reduzieren – ohne sichtbaren Qualitätsverlust.

Nvidia ersetzt klassische Texturkompression durch KI

Bisher nutzen Spiele sogenannte Block-Compression-Verfahren, um Texturen zu verkleinern. Diese Methode spart zwar Speicher, hat aber Grenzen bei Qualität und Effizienz.

Nvidia verfolgt mit Neural Texture Compression einen anderen Ansatz: Statt die Texturen vollständig im VRAM zu speichern, werden sie extrem stark komprimiert abgelegt. Ein kleines neuronales Netzwerk rekonstruiert sie anschließend während des Renderings in Echtzeit.

Die Berechnung läuft auf den Tensor Cores moderner GPUs, also speziellen KI-Einheiten, die bisher vor allem für Technologien wie DLSS genutzt werden.

Demo zeigt drastische VRAM-Ersparnis

In einer technischen Demo präsentierte Nvidia eine Szene einer toskanischen Villa, die mit herkömmlicher Texturkompression rund 6,5 GB VRAM belegte. Mit Neural Texture Compression reduzierte sich der Speicherbedarf auf lediglich 970 MB – bei praktisch identischer Bildqualität.

Ein weiteres Beispiel zeigte eine hochauflösende Helm-Textur:

- Unkomprimiert: 272 MB

- Block-Compression: 98 MB

- Neural Texture Compression: nur 11,37 MB

Das entspricht einer Reduktion um rund das 24-Fache gegenüber der Originalgröße.

Neural Rendering: Nvidia denkt Rendering komplett neu

Parallel stellte Nvidia auch eine zweite Technologie namens Neural Materials vor. Hier ersetzt ein neuronales Netzwerk die klassische Material-Berechnung im Rendering-Pipeline.

Statt komplexe physikalische Lichtmodelle (BRDF) pro Pixel zu berechnen, liefert das trainierte Netzwerk direkt das Ergebnis für Licht, Oberfläche und Blickwinkel.

In der Demo soll dies Renderzeiten um bis zu 7,7-fach beschleunigen – ebenfalls ohne sichtbaren Qualitätsverlust.

Die Technik ist nicht Nvidia-exklusiv

Interessant ist: Das zugrunde liegende Konzept wurde bereits von Microsoft in DirectX standardisiert. Dort läuft es unter dem Namen Cooperative Vectors. Dadurch könnten langfristig auch GPUs von AMD und Intel ähnliche Technologien nutzen.

Der Ansatz gehört zum größeren Trend des sogenannten Neural Rendering, bei dem KI-Modelle klassische Grafikberechnungen ersetzen oder unterstützen.

Was das für Spieler bedeuten könnte

Sollte sich Neural Texture Compression in der Praxis durchsetzen, hätte das mehrere Auswirkungen:

- deutlich geringerer VRAM-Bedarf moderner Spiele

- größere und detailliertere Spielwelten

- weniger Textur-Streaming und Ruckler

- potenziell kleinere Downloadgrößen

Gerade bei aktuellen PC-Grafikkarten mit 8 GB oder 12 GB VRAM könnte diese Technologie künftig eine wichtige Rolle spielen.

Wann kommt die Technologie in Spiele?

Aktuell unterstützt noch kein Spiel Neural Texture Compression. Nvidia hat die Technik bislang nur in technischen Demos gezeigt. Da Microsoft bereits eine DirectX-Integration vorbereitet, könnte sie jedoch mittelfristig in neuen Game-Engines auftauchen.

Damit würde KI nicht nur für Upscaling wie DLSS eingesetzt – sondern erstmals direkt für die effiziente Speicherung und Darstellung von Texturen.

Quelle: Nvidia GTC / Tom's Hardware